За последние 10 лет, благодаря способу так именуемого глубокого обучения, мы взяли самые лучшие совокупности ИИ — к примеру, распознаватели речи на смартфонах либо последний непроизвольный переводчик Гугл. Глубокое обучение, по сути, стало новым течением в уже известных нейронных сетях, каковые входили в моду и выходили в течении более 70 лет. В первый раз нейронные сети внесли предложение Уоррен Маккалоу и Уолтер Питтс в 1994 году, два исследователя Университета Чикаго.

В 1952 году они перешли трудиться в Массачусетский технологический университет, дабы заложить фундамент для первой кафедры когнитологии.

Нейронные сети были одним из главных направлений изучений как в нейробиологии, так и информатике до 1969 года, в то время, когда, если доверять преданиям, их прикончили математики Массачусетского технологического университета Марвин Мински и Сеймур Паперт, каковые через год стали соруководителями новой лаборатории ИИ MIT.

Восстановление данный способ пережил в 1980-х, легко ушел в тень в первом десятилетии нового века и с фанфарами возвратился во втором, на гребне немыслимого развития графических чипов и их обрабатывающей мощности.

«Имеется вывод, что идеи в науке — это как эпидемии вирусов», говорит Томазо Поджио, доктор наук когнитологии и наук о мозге в MIT. «Существует, по всей видимости, пять либо шесть главных штаммов вирусов гриппа, и один из них возвращается с завидной периодичностью в 25 лет. Люди заражаются, покупают иммунитет и не болеют следующие 25 лет. После этого появляется новое поколение, готовое к тому, дабы заразиться тем же штаммом вируса.

В науке же люди влюбляются в идею, она всех сводит с ума, после этого ее забивают до смерти и покупают иммунитет к ней — устают от нее. У идей должна быть подобная периодичность».

Весомые вопросы

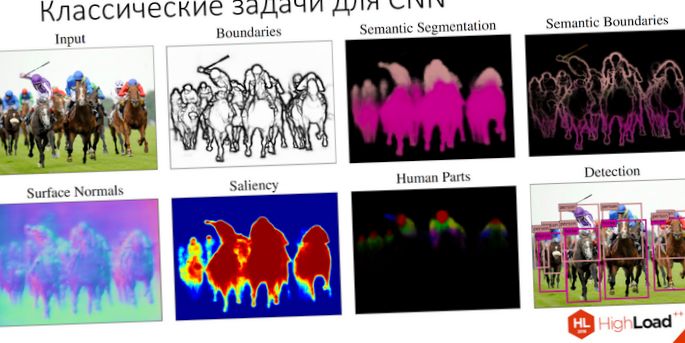

Нейронные сети являются способом машинного обучения, в то время, когда компьютер обучается делать кое-какие задачи, разбирая тренировочные примеры. В большинстве случаев, эти примеры вручную помечаются заблаговременно. Совокупность распознавания объектов, к примеру, может впитать тысячи меченых изображений машин, домов, кофейных чашек и без того потом, и после этого сможет обнаружить визуальные образы в этих изображениях, каковые последовательно коррелируют с определенными метками.

Нейронную сеть довольно часто сравнивают с людской мозгом, в котором также имеется такие сети, складывающиеся из тысяч либо миллионов несложных обрабатывающих узлов, каковые тесно связаны между собой. Большая часть современных нейронных сетей организованы в слои узлов, и эти проходят через них лишь в одном направлении. Отдельный узел возможно связан с несколькими узлами в слое под ним, из которого он приобретает эти, и несколькими узлами в слое выше, в каковые он эти передает.

Каждой из этих входящих связей узел присваивает номер — «вес». В то время, когда сеть активна, узел приобретает различные комплекты данных — различные числа — по каждому из этих соединений и умножает на соответствующий вес. После этого он суммирует оказавшиеся результаты, образуя единое число.

В случае если это число ниже порогового значения, узел не передает данные в следующий слой. В случае если же число превосходит пороговое значение, узел «активируется», отправляя число — сумму взвешенных входных данных — на все исходящие соединения.

В то время, когда нейронная сеть тренируется, все ее веса и пороговые значения изначально устанавливаются в случайном порядке. Тренировочные эти подаются в нижний слой — входной — и проходят через последующие слои, умножаясь и суммируясь сложным образом, пока, наконец, не прибудут, уже преобразованные, в выходной слой. На протяжении обучения веса и пороговые значения всегда подстраиваются, пока тренировочные эти с однообразными метками не начнут давать сходные выводы.

машины и Разум

Нейронные сети, обрисованные Маккалоу и Питтсом в 1944 году, имели и пороговые значения, и веса, но не были организованы послойно, а ученые не задавали никакого конкретного механизма обучения. Но Маккалоу и Питтс продемонстрировали, что нейронная сеть имела возможность бы, в принципе, вычислить любую функцию, как любой цифровой компьютер. Итог был больше из области нейробиологии, чем информатики: необходимо было высказать предположение, что человеческий мозг возможно разглядывать как вычислительное устройство.

Нейронные сети остаются полезным инструментом для нейробиологических изучений. К примеру, отдельные слои сети либо пороговых настройки значений и правила весов воспроизвели замечаемые изюминки людской нейроанатомии и когнитивных функций, соответственно, коснулись того, как мозг обрабатывает данные.

Первая обучаемая нейронная сеть, «Перцептрон» (либо «Персептрон»), была показана психологом Корнеллского университета Франком Розенблаттом в 1957 году. Дизайн «Перцептрона» был похож на современную нейронную сеть, за исключением того, что у него был один слой с порогами и регулируемыми весами, зажатый между входным и выходным слоями.

«Перцептроны» деятельно исследовались в информатике и психологии до 1959 года, в то время, когда Мински и Паперт издали книгу называющиеся «Перцептроны», которая продемонстрировала, что произведение в полной мере простых вычислений на персептронах было непрактичным с позиций временных затрат.

«Само собой разумеется, все ограничения как бы исчезают, в случае если сделать автомобили чуть более сложными», к примеру, в два слоя», говорит Поджио. Но в то время книга оказала сдерживающий эффект на изучения нейронных сетей.

«Эти вещи стоит разглядывать в историческом контексте», говорит Поджио. «Подтверждение строилось для программирования на таких языках, как Lisp. Незадолго до этого люди нормально применяли аналоговые компьютеры. Было не очевидно в то время, к чему по большому счету приведет программирование.

Думаю, они легко переборщили, но, как и неизменно, нельзя делить все на тёмное и белое. В случае если разглядывать это как состязание между цифровым вычислением и аналоговым вычислением, тогда они боролись за то, что было необходимо».

Периодичность

К 1980-м годам, но, ученые создали методы для модификации весов нейронных пороговых значений и сетей, каковые были достаточно действенны для сетей с больше чем одним слоем, устранив большое количество ограничений, определенных Мински и Папертом. Эта область пережила Ренессанс.

Но с разумной точки зрения в нейронных сетях чего-то недоставало. Достаточно долгая тренировка имела возможность привести к пересмотру настроек сети до тех пор, что она начнет классифицировать эти нужным образом, но что эти настройки означают? На какие конкретно особенности изображения наблюдает распознаватель объектов и как он собирает их по частям, дабы организовать визуальные сигнатуры автомобилей, домов и чашек кофе?

Изучение весов отдельных соединений не позволит ответа на данный вопрос.

Сейчас компьютерные ученые начали придумывать хитроумные способы для определения аналитических стратегий, принятых нейронными сетями. Но в 1980-х годах стратегии этих сетей были непонятными. Исходя из этого на рубеже столетий нейронные сети были вытеснены векторными автомобилями, другим подходом к машинному обучению, основанном на чистой и элегантной математике.

Недавний всплеск интереса к нейронным сетям — революция глубокого обучения — обязан индустрии компьютерных игр. Сложная графическая составляющая и стремительный темп современных игр требует аппаратного обеспечения, которое сможет угнаться за тенденцией, в следствии чего показался GPU (графический процессор) с тысячами довольно несложных обрабатывающих ядер на одном чипе. Весьма не так долго осталось ждать ученые осознали, что архитектура графического процессора замечательно подходит для нейронных сетей.

Современные графические процессоры разрешили выстроить сети 1960-х годов и двух- и трехслойные сети 1980-х в букеты из 10-, 15– а также 50-слойные сети сегодняшнего дня. Вот за что отвечает слово «глубокое» в «глубоком обучении». К глубине сети.

На данный момент глубокое обучение несёт ответственность за самые эффективные совокупности фактически во всех областях изучений ИИ.

Под капюшоном

Непрозрачность сетей все еще тревожит теоретиков, но и на этом фронте имеется подвижки. Поджио командует исследовательской программой на тему теоретических баз интеллекта. Недавно Поджио и его сотрудники выпустили исследование нейронных сетей в трех частях.

Первая часть, которая была опубликована в прошлом месяце в International Journal of Automation and Computing, направлено диапазону вычислений, каковые смогут проводить сети глубокого обучения, и тому, в то время, когда глубокие сети имеют преимущества над поверхностными. Части два и три, каковые были выпущены в виде докладов, направлены проблемам глобальной оптимизации, другими словами гарантирования, что сеть будет обнаружить настройки, каковые оптимальнее подходят к ее обучающим данным, и случаев, в то время, когда сеть так прекрасно осознаёт специфику обучающих ее данных, что не имеет возможности обобщать другие проявления тех же категорий.

Впереди еще большое количество теоретических вопросов, ответы на каковые нужно будет дать. Но имеется надежда, что нейронные сети смогут, наконец, порвать цикл поколений, каковые ввергают их то в жар, то в мороз.

Как работают нейронные сети

Интересные записи на сайте:

- Ученые: океан на спутнике юпитера европе может быть открытым

- Удобство использования сотовой связи

- Экипировка «ратник»: время пришло

- Прожорливая звезда может хранить тайну образования планет

- Nasa обеспечит мкс стабильным интернетом

Подобранные по важим запросам, статьи по теме:

-

Умные осветительные сети обеспечат экономию энергии и безопасность

В то время, как большая часть людей ограничиваются заменой простых ламп на светодиодные для экономии электричества, калифорнийская компания отыскала…

-

А. В. Продолжительных При добыче нужных ископаемых подземным методом используются разные совокупности разработки, а главными факторами выбора той либо…

-

У марса появился frend. сделанный в ики прибор ищет воду на красной планете

N 52(2016) Дризе Юрий 30.12 Алексей Малахов пришел в Университет космических изучений (ИКИ) РАН на практику 13 лет назад, да тут и остался. Программист с…

-

Подключение к wi-fi сети с компьютера

На данный момент вай-фай есть одним из самый распространенных способов раздачи интернета на ограниченном по площади пространстве. Само собой разумеется,…

-

Как с помощью искусственных нейронных сетей найти курильщика по кардиограмме (и зачем это нужно)

На Хабре уже писали о научном конкурсе для разработчиков и математиков, что запустили создатели мобильного кардиографа CardioQVARK. Кратко, сущность…

-

Наса составило портрет плутона из фотографий пользователей сети

Ученые из проекта New Horizons опубликовали необыкновенную фотографию Плутона, на которой в роли «пикселей» выступают сэлфи людей, участвовавших в акции…